Ollama+OpenWebUI+deepseek-V3大模型在windows11环境部署deepseek-V3大模型

想要探索人工智能在智慧审计应用中的实现路径,本地化部署大模型应用是开展实践工作的第一步。Ollama是一个用于在本地运行大型语言模型的开源框架,简明易用。OpenWebUI是一个仿照ChatGPT界面,为本地大语言模型提供图形化界面的开源项目,可以非常方便的调试、调用本地模型。本文以实现Ollama+OpenWebUI在windows11环境部署为例,简要介绍一下整个安装部署环节的要点。

1. 环境要求

操作系统:Windows11操作系统

内存要求:16GB或更多内存

硬件要求:至少拥有4GB显存的Nvidia显卡

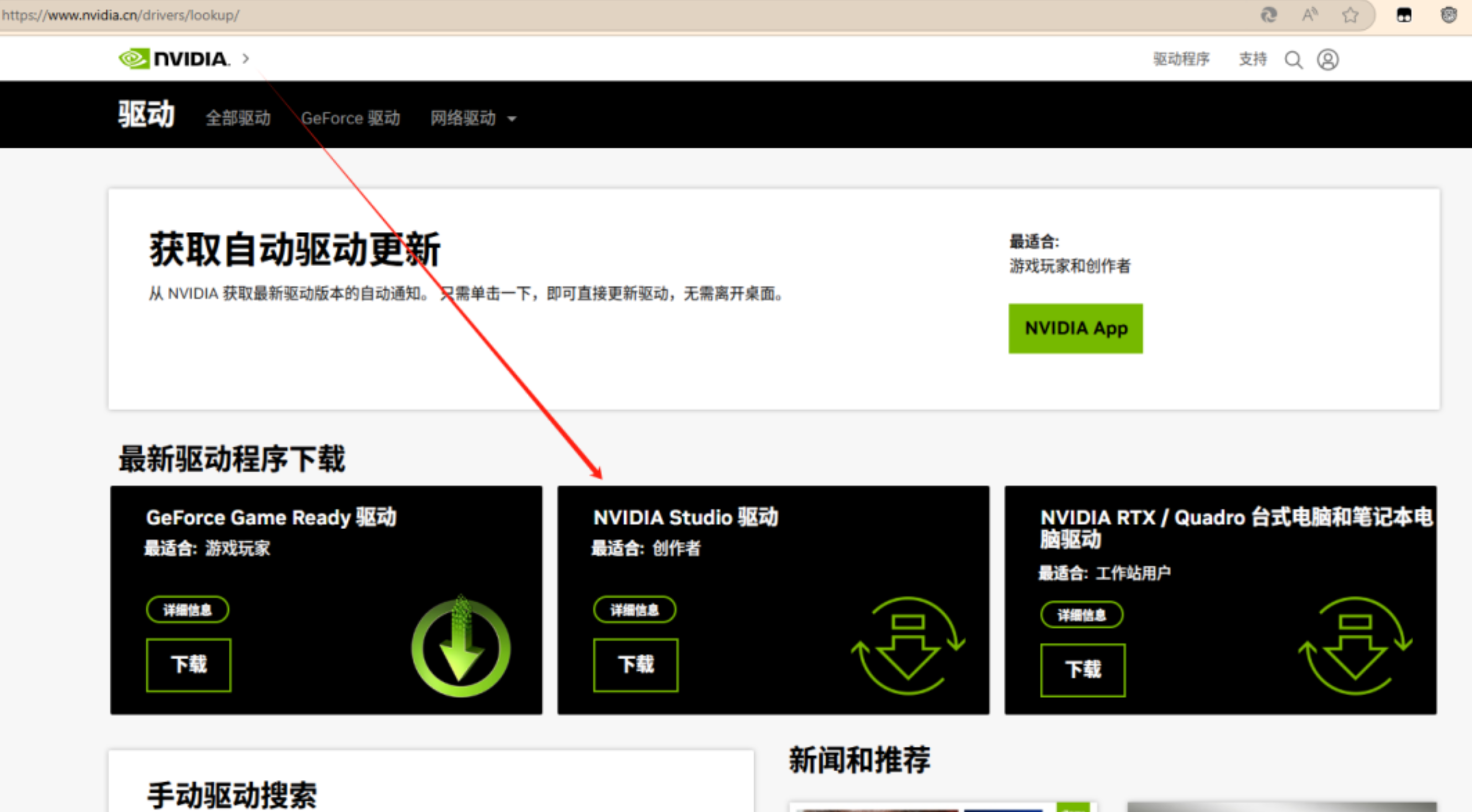

2. 显卡驱动和CUDA的安装

① 显卡驱动:官网下载并安装NVIDIA Studio 驱动

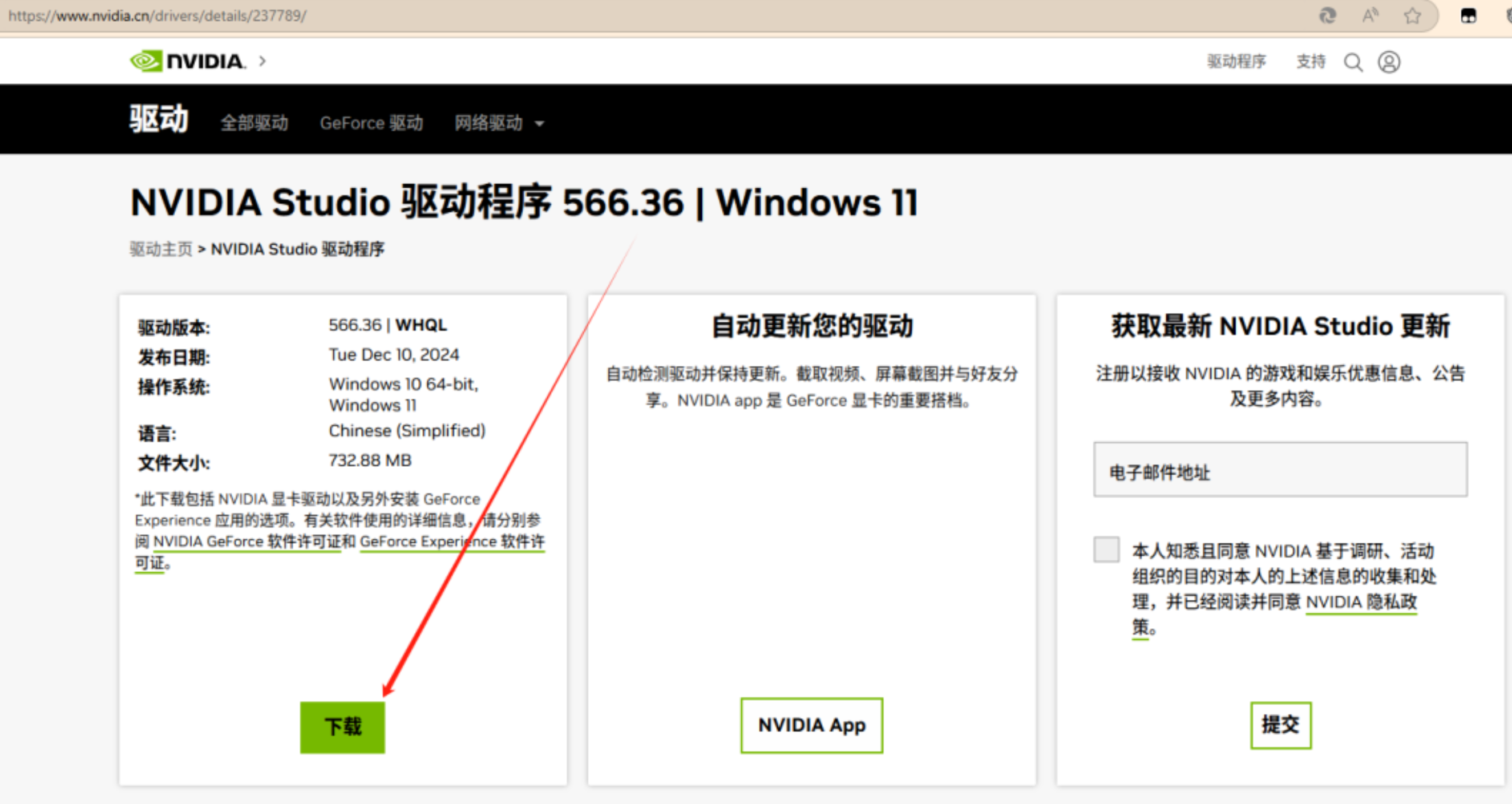

② CUDA工具:

这是利用显卡算力运行大模型的关键程序,必须安装。

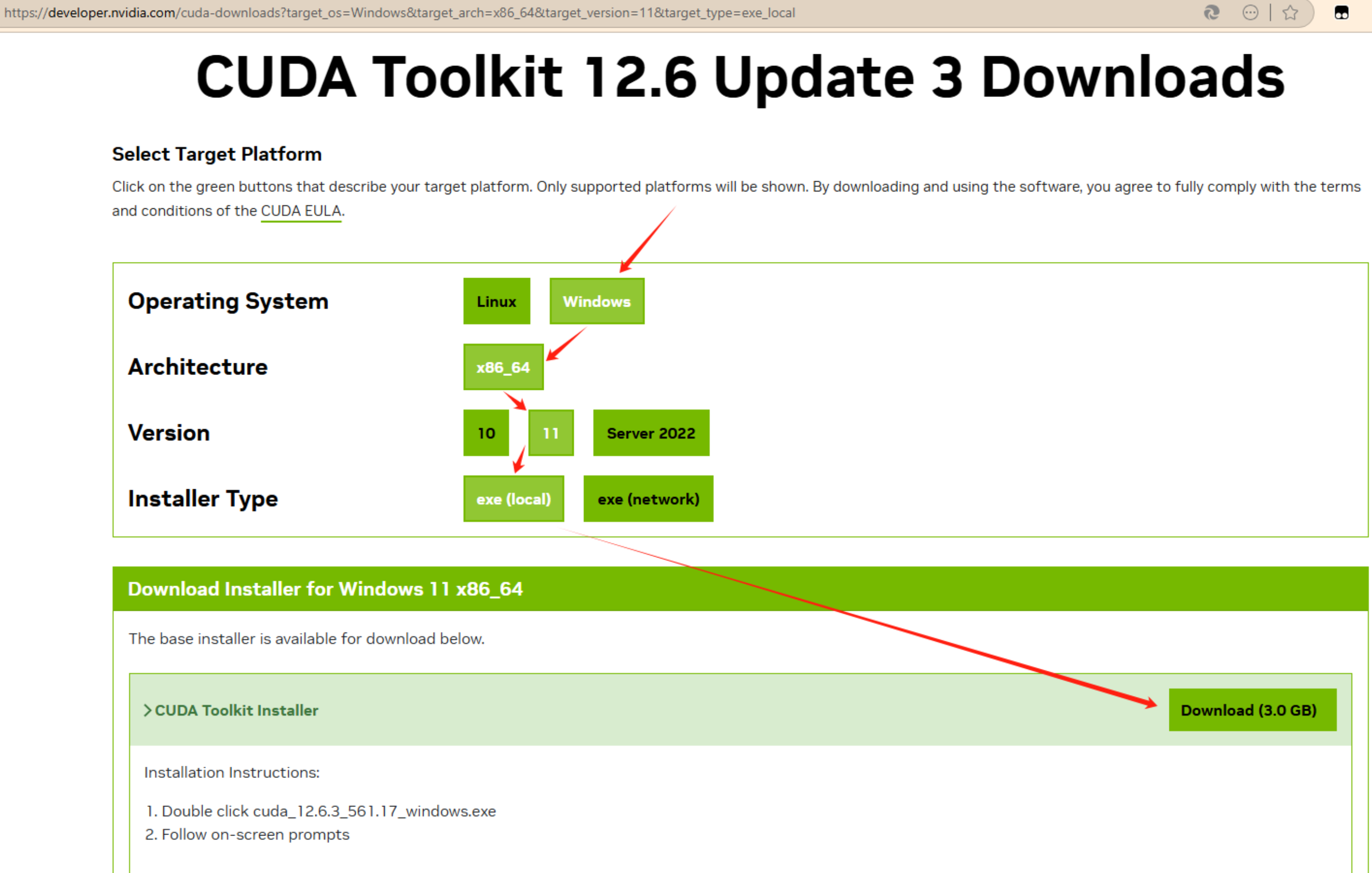

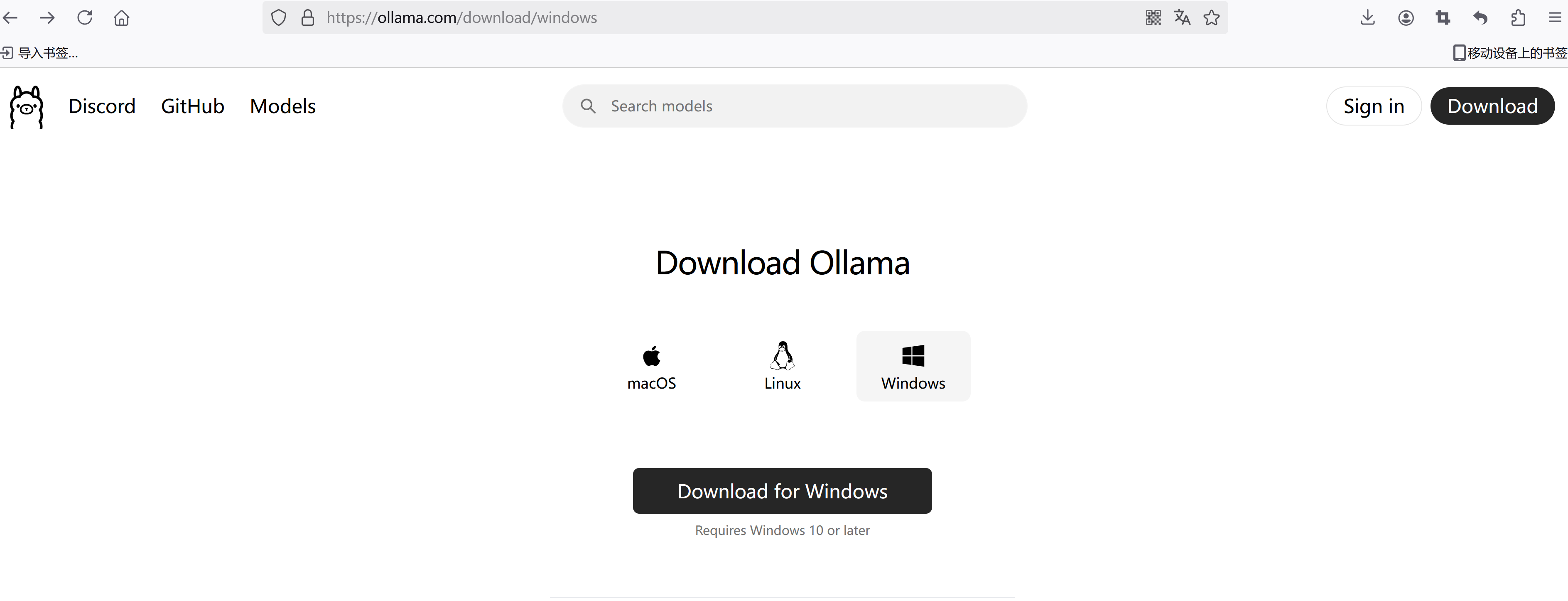

3. 安装ollama

下载地址:Ollama(ctrl+鼠标左键点击蓝色连接即可打开网页,下同)

下载到的文件:OllamaSetup.exe

注:本文所有程序的具体安装过程和配置要求如有疑问,请读者自行搜索教程,本文不再一一赘述。

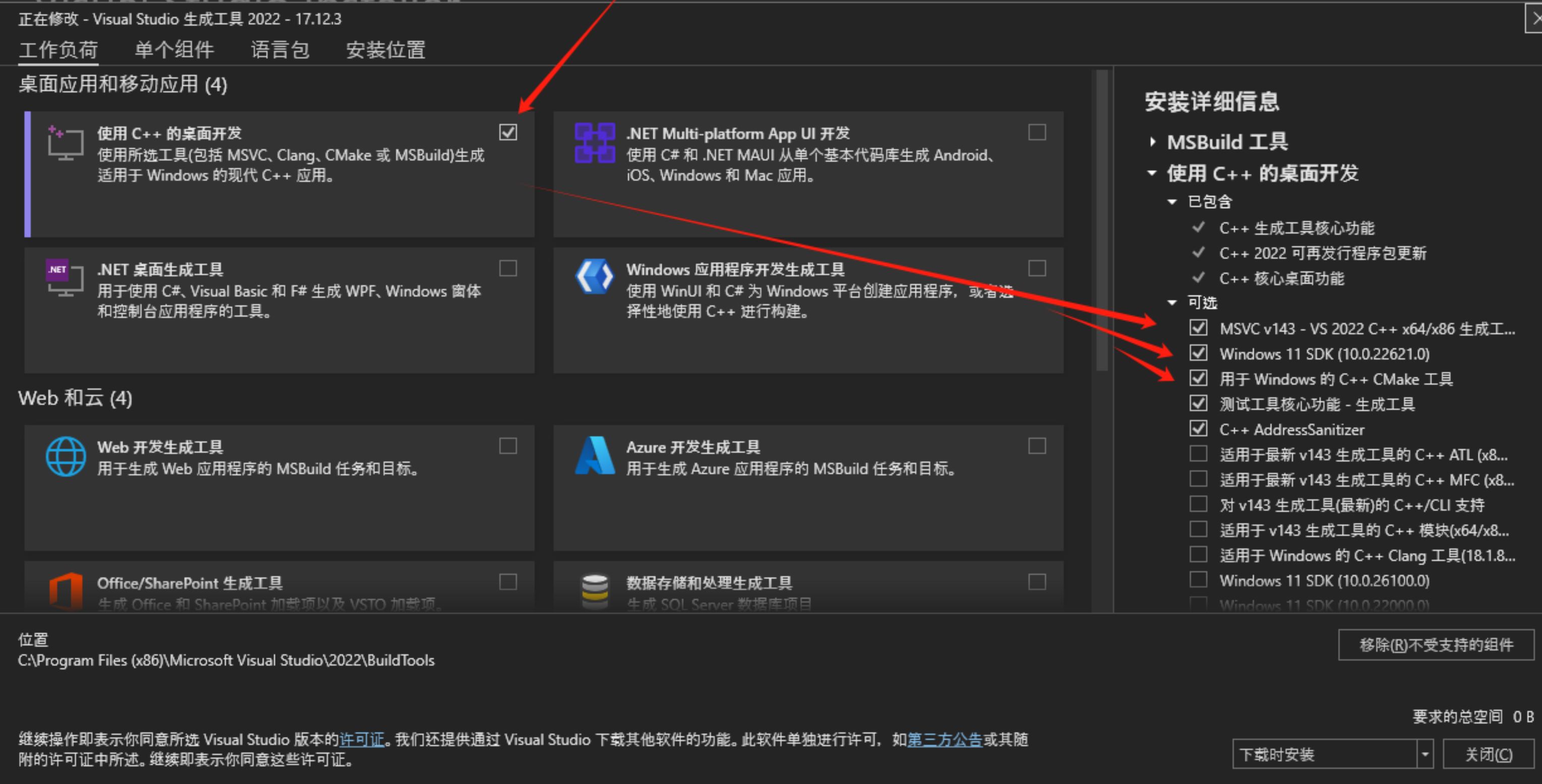

4. 安装Microsoft C++ 生成工具

下载地址:Microsoft C++ 生成工具 - Visual Studio

下载到的程序:vs_BuildTools.exe

启动后等待下载完整安装包,待进入安装界面后,选择使用c++的桌面开发,默认选项如下图:

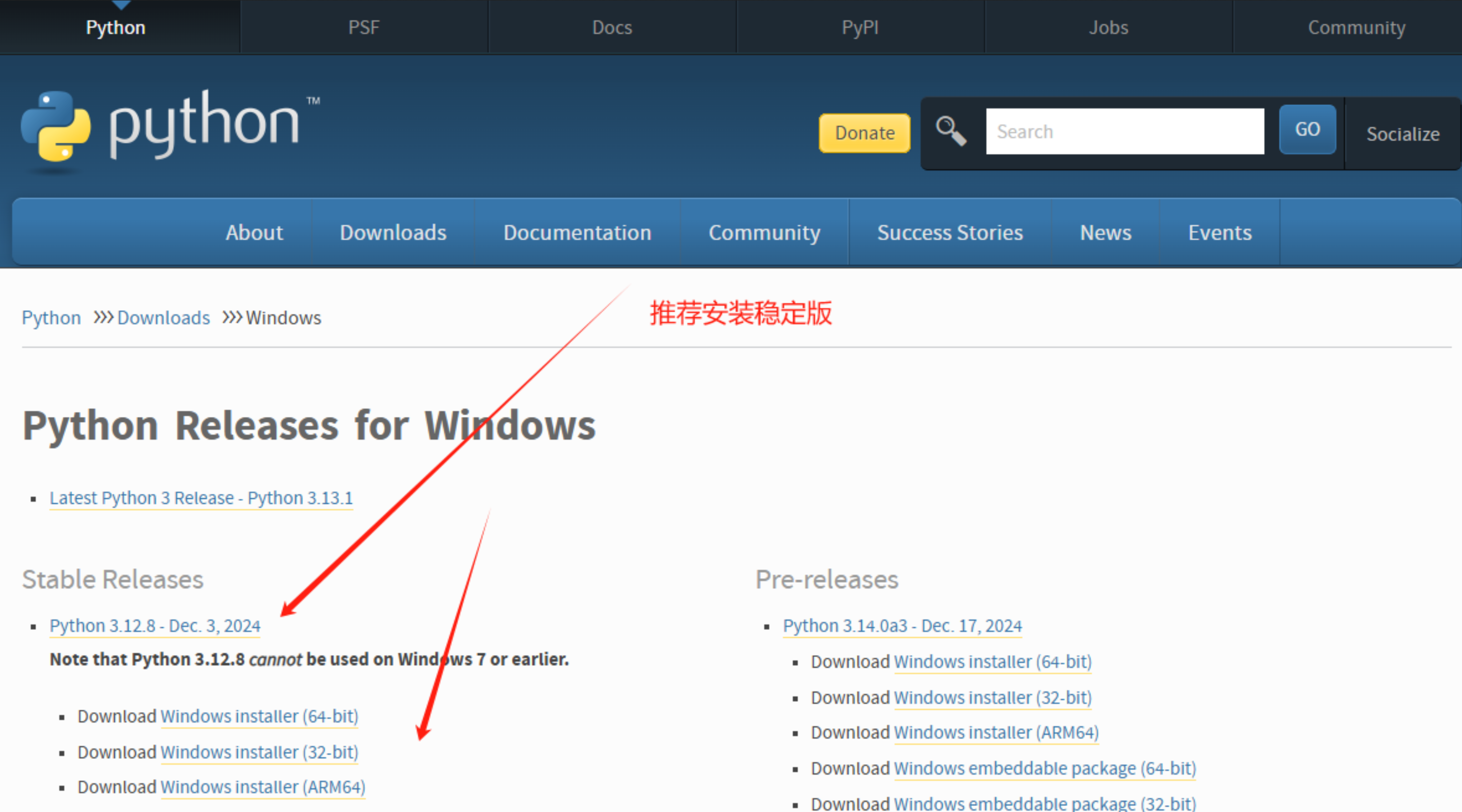

5. 安装python

下载地址:Python Releases for Windows | Python.org

下载到的程序:python-3.12.8-amd64.exe

这里下载的是windows64位版,自行安装即可。

6. pip升级到最新版本

打开终端执行pip升级命令:

python -m pip install --upgrade pip setuptools

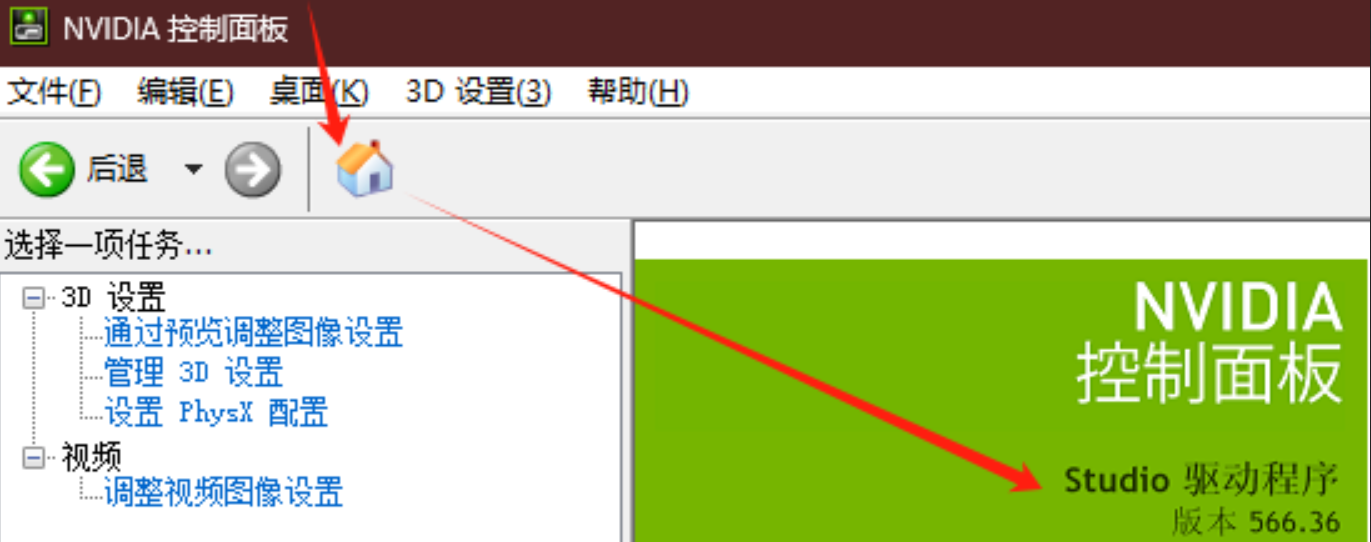

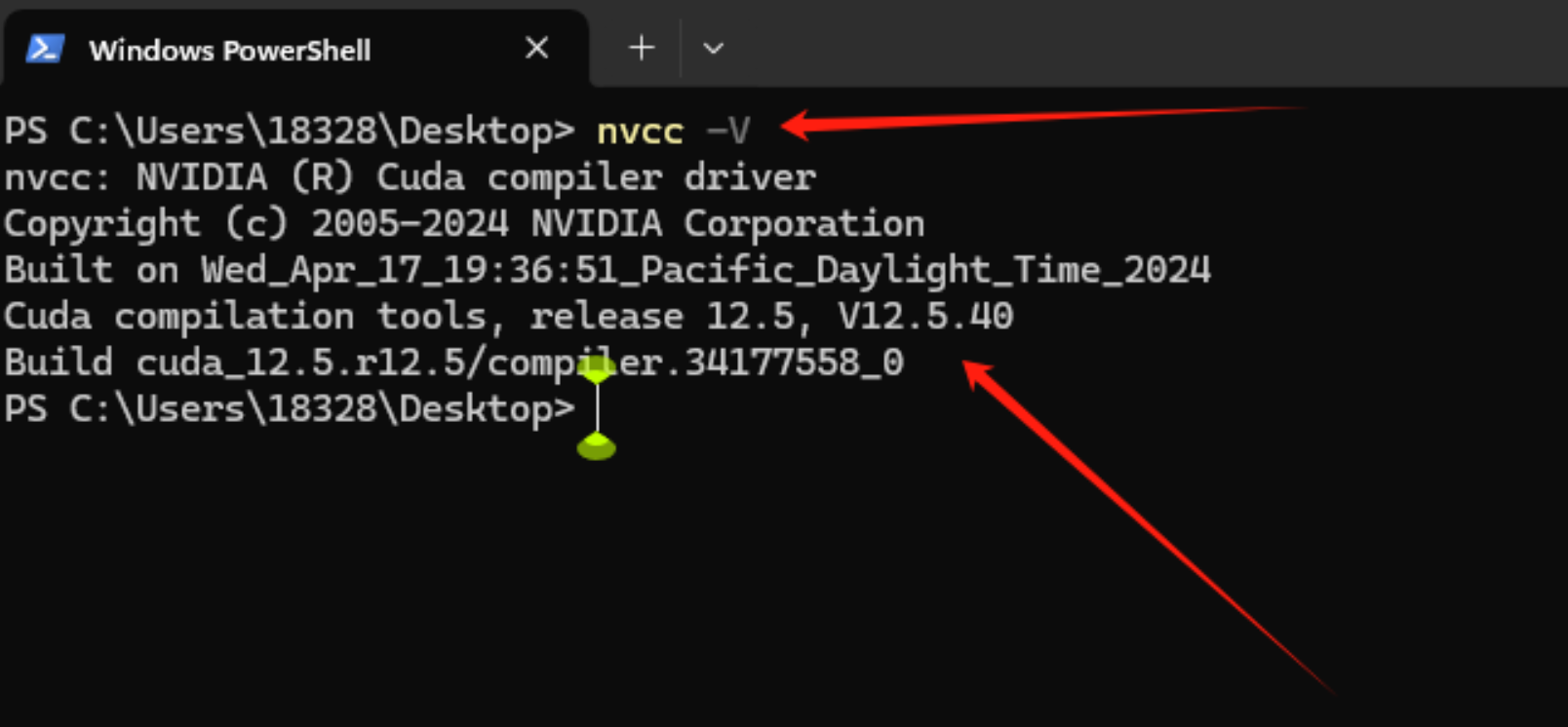

7. 至此检查一下各种软件安装情况

① 打开Nvidia控制面板如下:

② 打开终端执行命令nvcc -V查看CUDA版本:

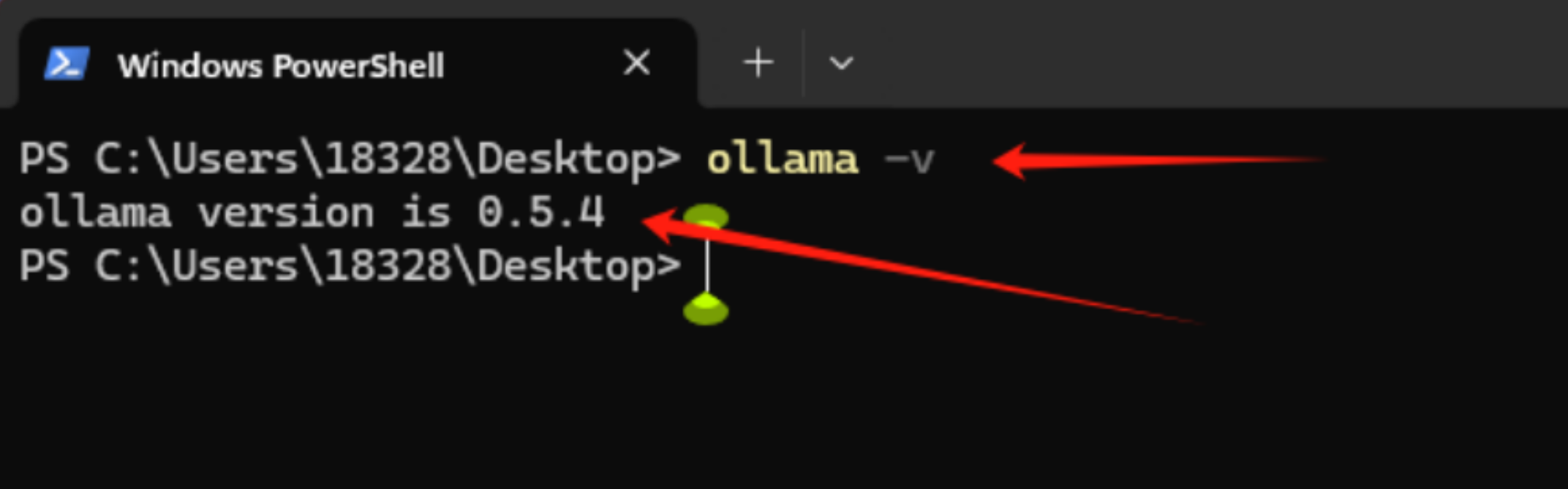

③ 打开终端执行命令ollama -V查看Ollama版本:

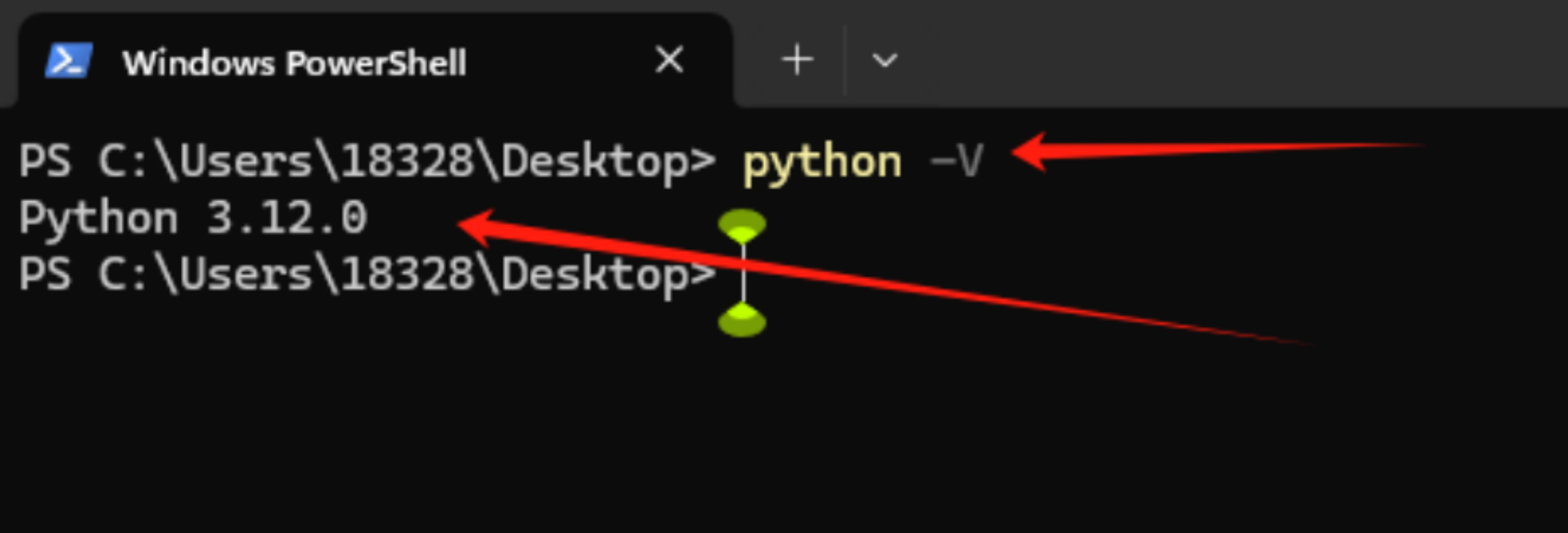

④ 打开终端执行python -V命令查看Python版本:

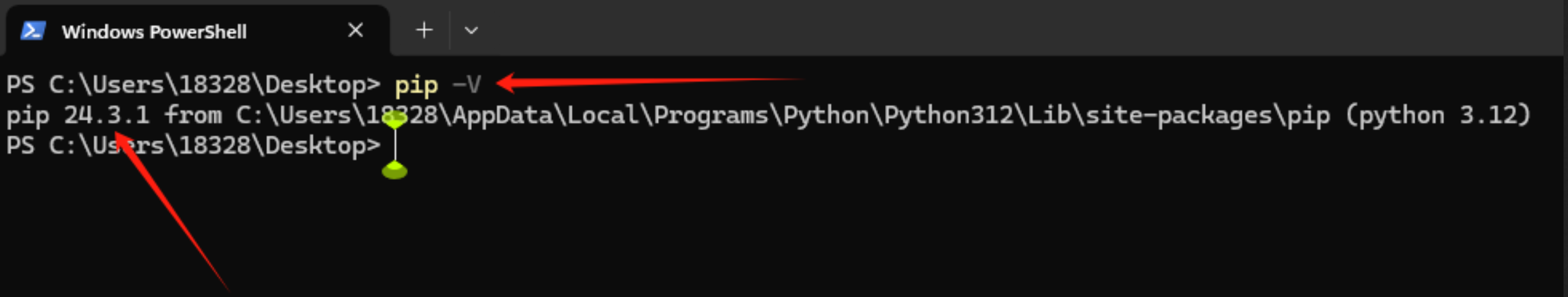

⑤ 打开终端执行pip -V命令查看Pip版本:

以上执行结果都有正常输出就可以安装OpenWebUI了!每个软件的版本号以具体安装的版本为准,这里只是展示一下显示的样式。

8. 安装OpenWebUI

打开终端执行以下命令,等待安装完毕即可:

pip install open-webui -i https://pypi.tuna.tsinghua.edu.cn/simple

以后需要升级到新版本时,打开终端执行以下命令:

pip install --upgrade open-webui

9. 下载deepseek-V3大模型

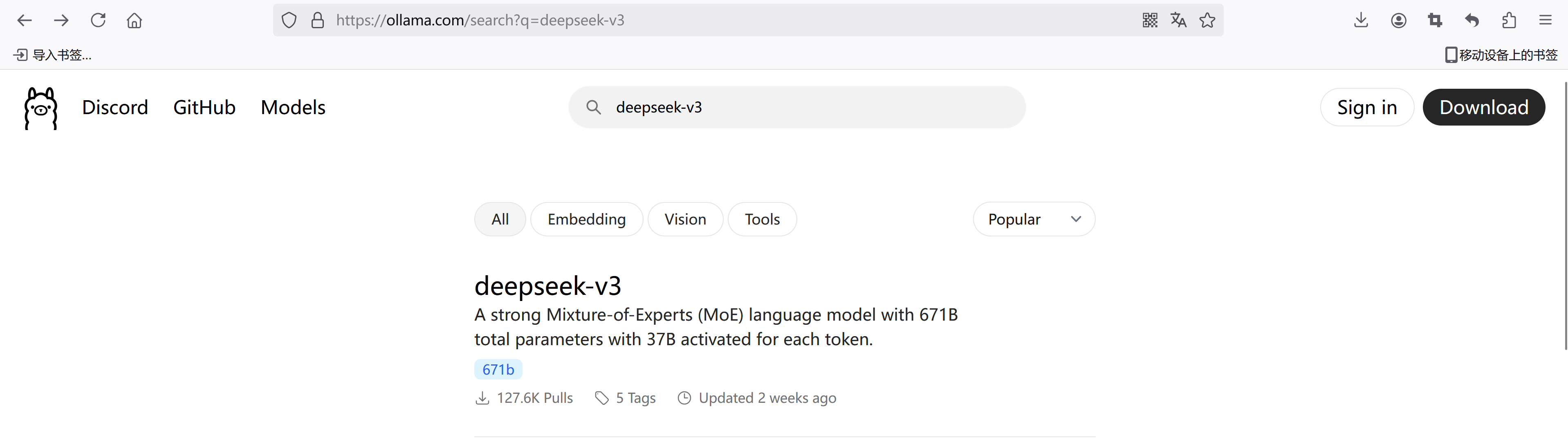

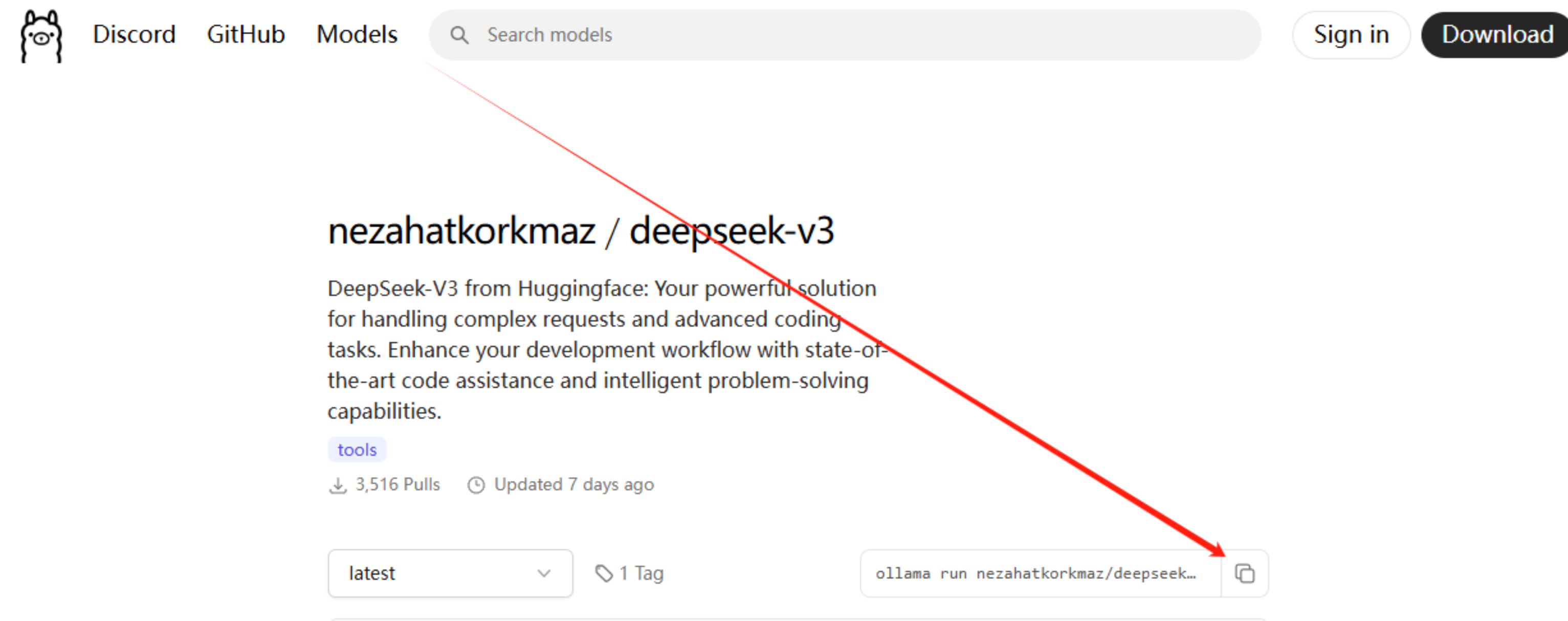

为了首次启动OpenWebUI后就能直接体验大模型,需要在启动OpenWebUI之前,可以先下载一个ollama的最新开源大模型deepseek-v3。首先打开浏览器,访问ollama网站并搜索deepseek-v3,当然也可以搜索下载其他大模型,比如搜索千问系列搜索关键字“qwen”,具体如下图所示:

点击上图的“nezahatkorkmaz/deepseek-v3”打开连接,如下图所示:

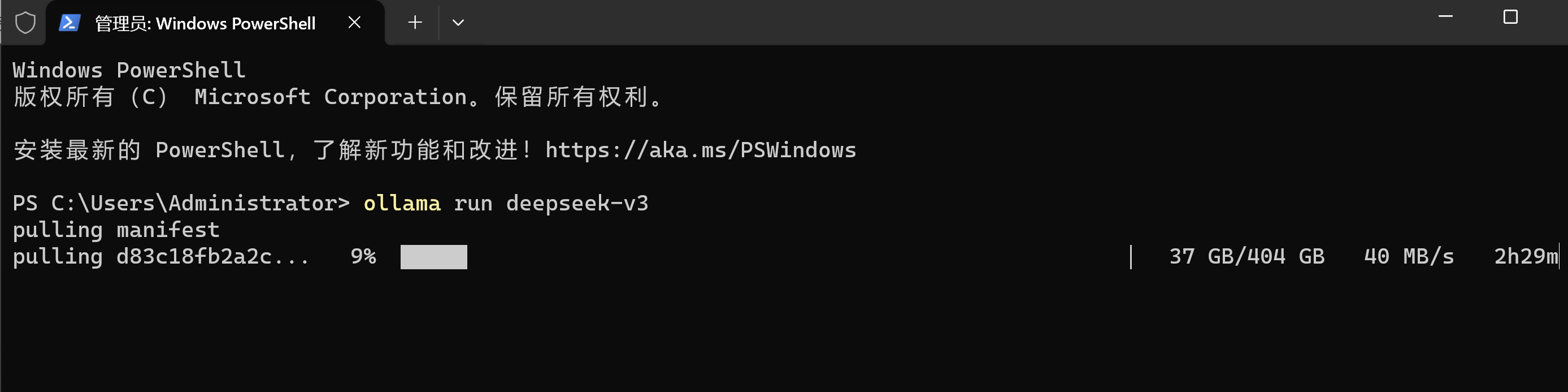

点击上图中的箭头所指,就会复制到下载该大模型的命令,然后打开终端,在光标处点击鼠标右键、粘贴、回车,执行以下命令,等待下载完毕,即可下载到这个大模型。

具体如下图所示:

看到上图提示后,表示这个大模型已经下载完毕了!其他大模型的下载也可如法炮制即可。其实,如果此时在命令行中输入问题,大模型已经可以回答问题了。但是因为在字符界面,效果并不理想。可按ctrl+d快捷键即可退出并回到正常的提示符。

10. 启动OpenWebUI

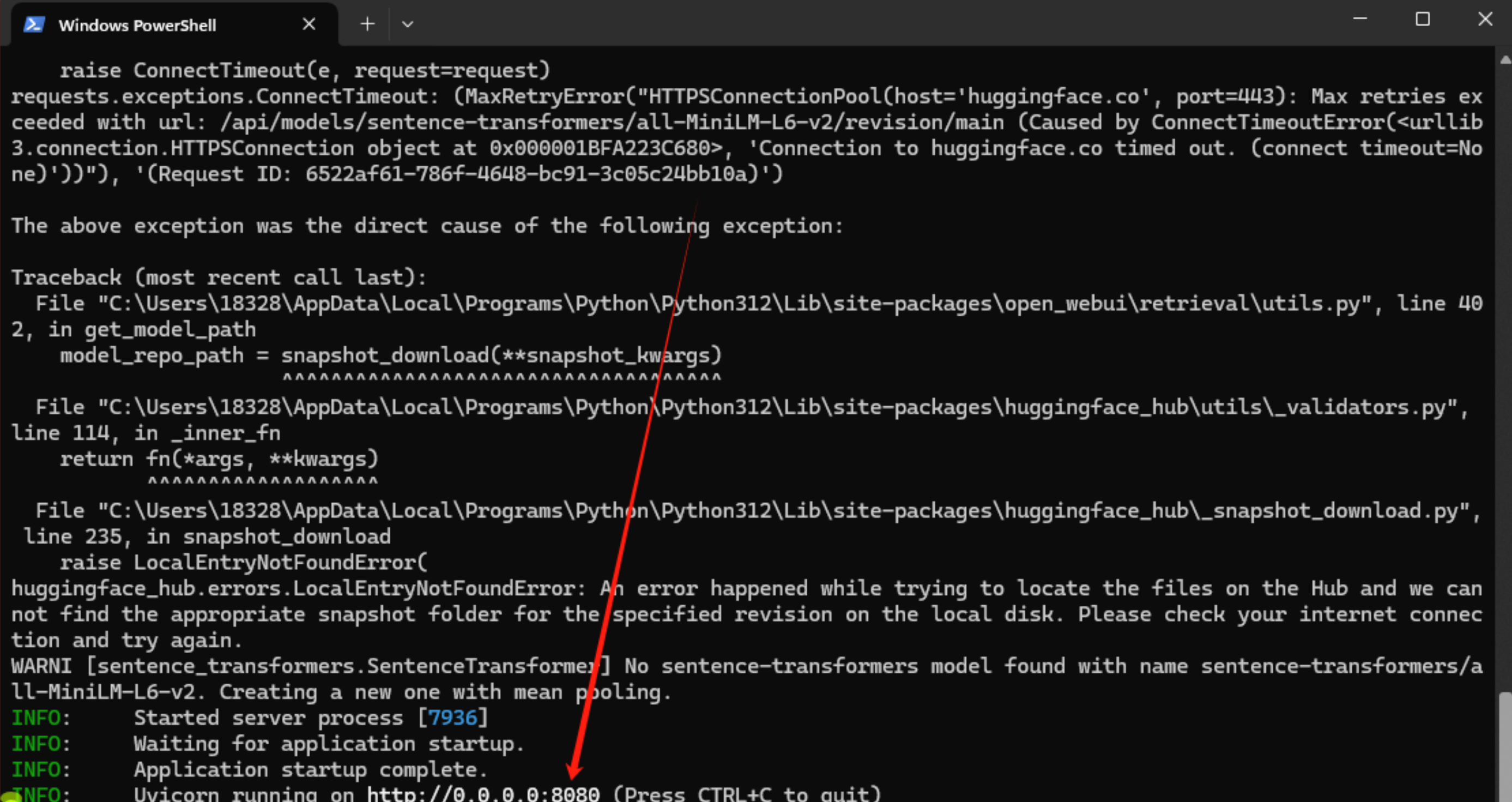

至此,在终端窗口执行以下命令:open-webui serve

启动时间略长,耐心等待OpenWebUI启动完毕。

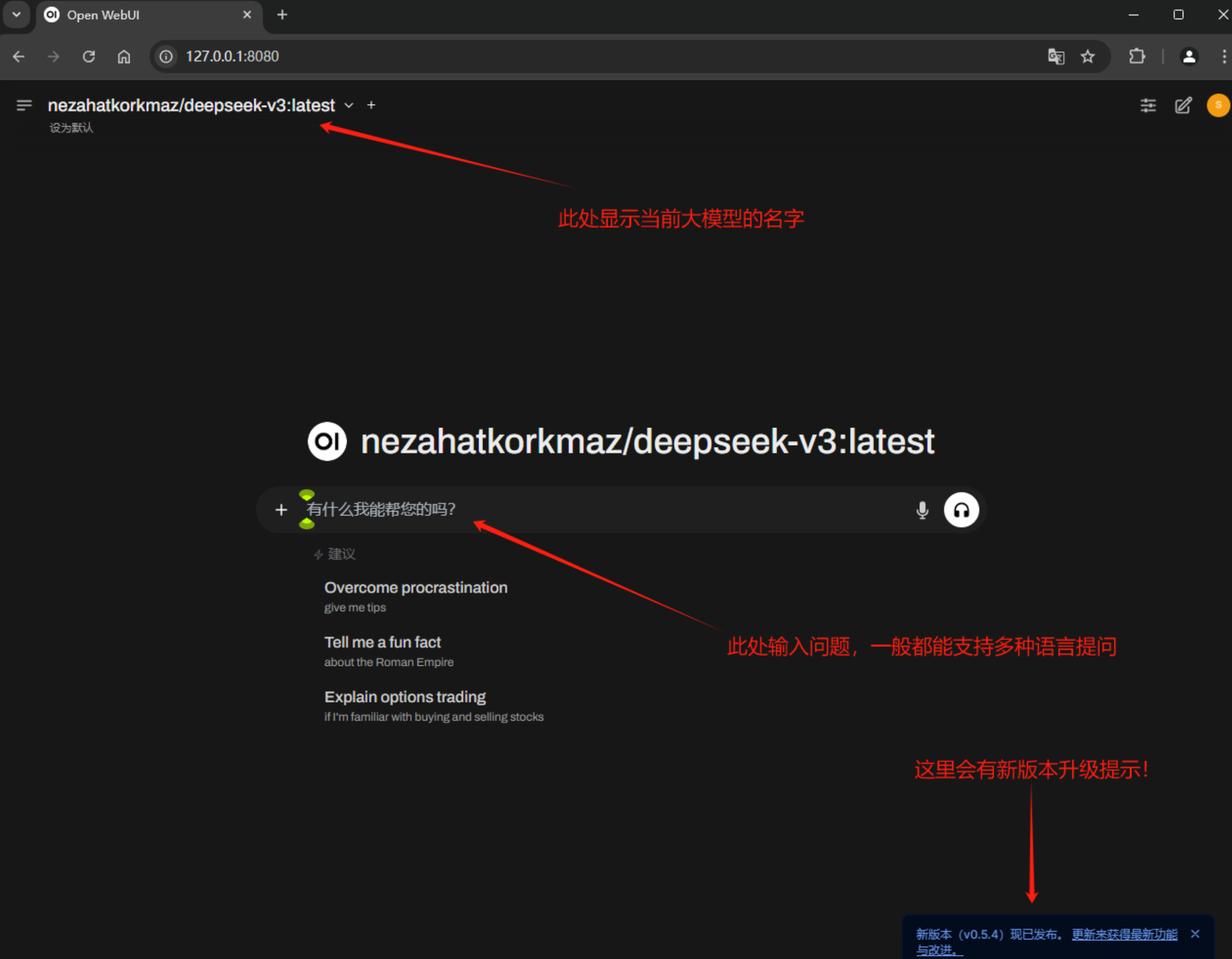

见到上图这种情况,就是启动好了。这时候可以打开浏览器,输入以下地址就能打开OpenWebUI的界面了!首次启动的时候OpenWebUI会要求注册一下,之后就如下图所示:

至此,本地化大模型就可以运行了!如果已经下载了多个大模型,则可以在左上角点开下拉菜单,随时切换成其他大模型。如果右下角有如图所示的升级提醒,则可以在终端窗口执行open-webui的升级命令。系统默认是深色模式,通过设置也可以修改其他预制的配色方案。